(投资早餐)华尔街都低估了生成式AI的跨行业需求

今日新闻:

1. 华尔街低估了跨行业对生成人工智能的需求。 英伟达第二季度业绩指引超出华尔街预期 53%。 AI超算系统将为英伟达带来更多超额回报;

2、Intel公布了Aurora genAI大模型,其参数是ChaGPT的近6倍。 多规格参数模型是平衡成本与效率的“最优方案”;

3、Meta开源了多语言语音模型MMS,可识别4000种语言,生成1000种语音;

4. 斯坦福等学者发布机器视觉跟踪重大突破,SiamMAE可节省高额成本;

观点

1、华尔街低估了生成AI的跨行业需求,AI超算系统将为英伟达带来更多超额回报。

英伟达Q1财报超预期成为今日关注焦点。 更重要的是,Q2的业绩指引将成为公司有史以来最高的季度营收,超出华尔街预期53.2%。

英业达业绩超预期背后,四大业务中贡献最大的是数据中心业务,营收创历史新高42.8亿美元,同比增长14%,环比增长18%。 此外,汽车业务虽然占比较小全天加拿大28QQ信誉群,但也实现了同比增长。 对游戏和专业可视化的需求显然还没有回到一年前的水平。

简智研究认为,市场远低估了生成式AI的需求,AI超算系统将为英伟达带来更多超额回报。

Nvidia 数据中心收入的激增主要是由于对生成 AI 和大型语言模型的需求不断增长,这推动了该公司对基于 Hopper 和 Ampere 架构的 GPU 的需求超出预期。 目前,数据中心产品的需求能见度已延续数个季度,下半年H100的供应量将进一步增加。

从客户需求来看:云计算服务商、消费者网络公司、企业客户都希望尽快将生成式AI应用到现有业务中。 根据订单调度情况,全年GPU都会出现供不应求的情况。 因此,预计英伟达的营收将继续受益于生成式人工智能驱动的数据中心业务的增长。

生成式AI对于整个行业来说是一种颠覆性的存在,从无到有,还处于起步阶段,能够创造的价值空间非常具有想象空间。

根据 Gartner 的预测,到 2025 年,使用生成式 AI 技术系统开发的新药和新材料的比例将从现在的 0% 上升到 30%+,而这只是其众多行业用例之一。 此外,生成式人工智能技术还在芯片、元器件设计、合成数据等诸多领域带来新的价值。

值得注意的是,生成式 AI 正在推动计算需求呈指数级增长,并快速过渡到 NVIDIA 的加速计算。 该公司还表示,将开始向支付溢价的科技公司销售 AI 超级计算系统。

目前英伟达拥有高性能网络条件优势PC蛋蛋QQ群薇!!,进一步优化计算结构、内存调用、通信效率和速度,将增加对高性能交换机、光模块、光纤的需求。

2、Intel公布了大规模AI模型Aurora genAI,其参数是ChatGPT的近6倍。 多规格参数模型是平衡成本和效率的“最优方案”。

Intel公布了其大型生成AI模型Aurora genAI,参数量达1万亿,是ChatGPT(1750亿参数)的近6倍,依托Megatron和DeepSpeed框架,增强了AI的实力和能力模型 。

Aurora genAI模型是一个纯粹以科学为中心的生成式AI模型,主要用于科学研究; 运行在英特尔为阿拉贡国家实验室开发的Aurora超级计算机上,其性能达到了200亿次,是目前TOP500超级计算机。 数量是冠军Frontier的两倍。

简智研究认为:作为ChatGPT的有力竞争者,Aurora genAI的发布预示着AI大规模模型赛道迎来新的重量级选手,极有可能对各个科学领域产生重大影响将来。

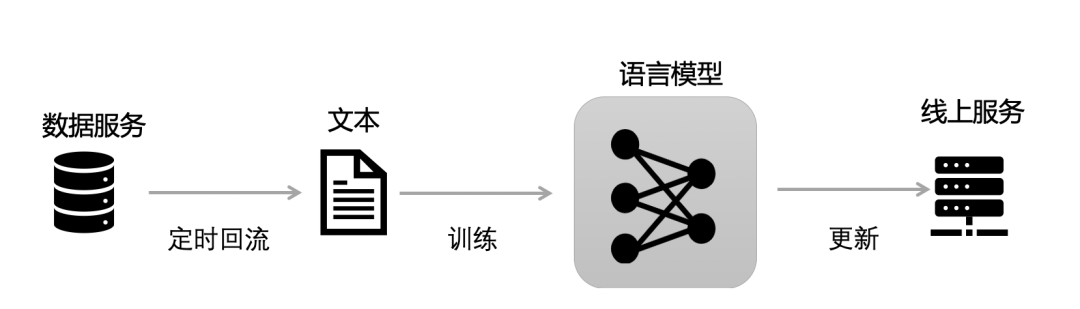

另外值得注意的是,LLM模型的研发将继续涉及训练参数的扩展,但更大规模模型的运行必然会产生更高的成本。 目前如何平衡有效需求和成本成为大型车型的发展方向。 最值得关注的问题是在模型应用过程中加拿大28群大全加拿大28群吧,如何避免因参数冗余而产生不必要的运行成本。 因此,针对特殊领域引入多样化的参数模型,将成为大型模型开发商的必然发展路径。

人工智能新闻

1、Meta开源了多语言语音模型MMS,可识别4000种语言

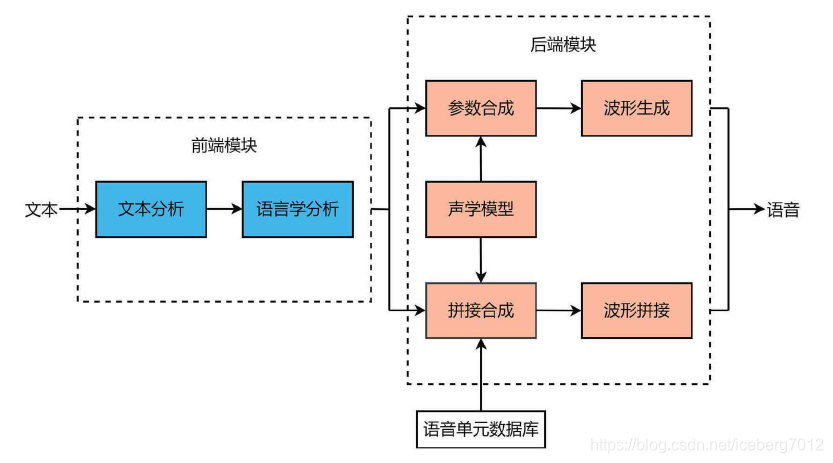

Meta再次在GitHub上开源了一种新的AI语言模型——Massively Multilingual Speech(MMS,大规模多语言语音)。 这种新的语言模型可以识别超过 4000 种口头语言并生成超过 1100 种语音(文本到语音)。 上线短短几个小时ai大模型日报,GitHub仓库收获了23k Stars,Fork数达到5.5k。

Meta被视为大模型开发中的一匹大黑马PC蛋蛋群谁有,是开源大模型的鼻祖。 之前发布的 LLaMA 是最微调的通用模型。 此前,该公司的SAM视觉模型在CV领域一炮而红。 公司在开源多模态领域的持续发力ai大模型日报,进一步为开源社区提供强大的技术支持。

2. 斯坦福&普林斯顿学者发现计算机视觉跟踪新技术,可节省高额成本

建立图像或场景之间的对应关系是计算机视觉中的一个重要挑战,尤其是考虑到遮挡、视点变化和物体外观的变化。

在斯坦福和普林斯顿大学学者联合发表的一篇名为【Siamese Masked Autoencoders】的论文中,发表了一种用于视频学习的masked autoencoder。 SiamMAE 用于从视频中学习视觉对应。 它可以在 Allows machines to learn autonomously without explicit labels or annotations 中找到。 学习到的表示可用于下游任务,例如视频分类、动作识别或对象跟踪。

SiamMAE 学习到的特征在视频对象分割、姿势关键点传播和语义部分传播等自监督方法中表现非常出色。 这种方法在标记数据稀缺或获取成本高昂的情况下特别有用。

| 广告位 |